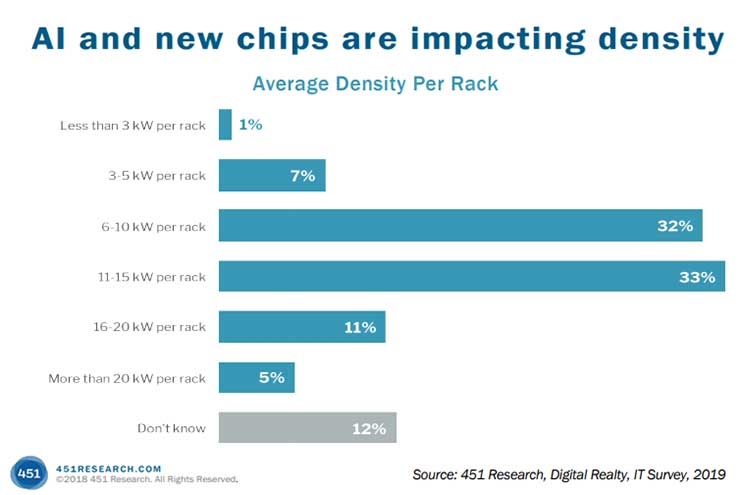

Исследовательская компания 451 Research опубликовала отчёт, в котором говорится, что плотность «упаковки» вычислительных мощностей в ЦОД активно растёт, и эта тенденция будет продолжаться. До недавних пор показатель потребления энергии составлял в среднем 5 киловатт на стойку, однако, в последний год наблюдался активный рост, а 45% из 750 опрошенных компаний ожидают дальнейшего повышения этого показателя до 11 и более киловатт в течение следующего, 2020 года.

В прошлом году лишь 18% опрошенных сообщили о мощностях свыше 10 киловатт на стойку, так что это очень серьёзный рост. Что вызывает такой рост плотности и потребляемых мощностей? Серьезная доля приходится на набирающие популярность приложения машинного интеллекта. Именно в этой сфере используются максимально сложные процессоры, упакованные в максимально компактный формат ‒ по нескольку огромных и имеющих солидное энергопотребление чипов в каждом серверном корпусе.

И это не только чипы-монстры, разработанные NVIDIA или AMD ‒ можно вспомнить анонс тензорного процессора Groq TSP с производительностью 1 Петаопс (PetaOPS, 1015 операций в секунду) или новые ИИ-ускорители Graphcore C2 с 1216 ядрами и огромным кристаллом.

Всё это создаёт ряд проблем, включая растущие требования к охлаждению серверных комнат, наполненных подобным оборудованием. Владельцы ЦОД активно ищут новые способы отвода огромного количества тепла и всё охотнее внедряют системы жидкостного охлаждения.

По мнению 451 Research, 2020 год должен стать годом активного внедрения такого охлаждения в крупных центрах обработки данных. Катализатором может послужить решение Google о переводе последнего поколения серверного аппаратного обеспечения компании на СЖО. Впрочем, некоторые гиганты, например, Microsoft, хотя и экспериментируют с жидкостными системами, но пока откладывают окончательное решение, а иные, как Facebook, считают, что у воздушного охлаждения ещё есть задел на будущее.