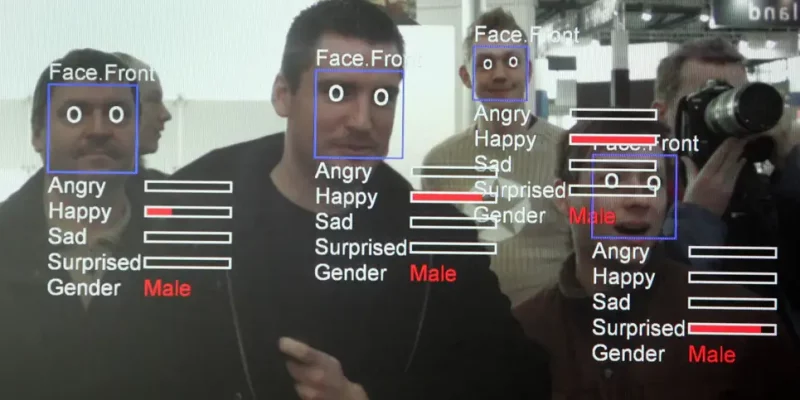

Microsoft відмовляється від своєї підозрілої з наукової та етичної точки зору технології розпізнавання емоцій. Принаймні зараз. Як велику перемогу для захисників конфіденційності, що б’ють на сполох з приводу недостатньо протестованих та інвазивних біометричних технологій, Microsoft оголосила, що планує видалити свої так звані системи виявлення «розпізнавання емоцій» зі своїх служб розпізнавання осіб Azure Face. Компанія також поступово відмовиться від можливостей, які намагаються використати ШІ для визначення атрибутів особистості, таких як стать та вік.

Рішення Microsoft загальмувати спірну технологію було ухвалено на тлі серйозного перегляду її етичної політики. Наташа Кремптон, головний відповідальний за штучний інтелект Microsoft, сказала, що рішення компанії було прийнято у відповідь на думку експертів, які вказали на відсутність консенсусу щодо визначення «емоцій» та побоювання надмірного узагальнення того, як системи штучного інтелекту можуть інтерпретувати ці емоції.

«Ми співпрацювали з внутрішніми та зовнішніми дослідниками, щоб зрозуміти обмеження та потенційні переваги цієї технології та знайти компроміси», — заявила в окремій заяві керівник продукту Azure AI Principal Group Сара Берд. «Доступ API до можливостей, які передбачають конфіденційні атрибути, також відкриває широкий спектр способів їх неправомірного використання, включаючи створення стереотипів, дискримінацію або несправедливу відмову в обслуговуванні людей», — додав Берд.

Берд сказав, що компанія відмовиться від системи загального призначення в Azure Face API, яка намагається виміряти ці атрибути, щоб знизити ризики. Починаючи з вівторка, нові клієнти Azure більше не матимуть доступу до системи виявлення, хоча поточні клієнти зможуть припинити її використання до 2023 року. Важливо відзначити, що хоча Microsoft заявляє, що її API більше не буде доступним для загального використання, Берд сказав, що компанія все ще може досліджувати цю технологію в деяких обмежених випадках використання, зокрема як інструмент для підтримки людей з обмеженими можливостями.

«Microsoft визнає, що ці можливості можуть бути корисними при використанні для набору сценаріїв контрольованого доступу», — додав Берд.

Виправлення курсу відбувається у спробі привести політику Microsoft у відповідність до її нового 27-сторінкового документа «Стандарт відповідального ШІ», який розробляється рік. Серед інших рекомендацій стандарт закликає Microsoft забезпечити належне керування даними у своїх продуктах, підтримувати поінформований людський нагляд та контроль та «надавати дієві вирішення проблем, для вирішення яких вони призначені». Джерело

Comments