Google рассматривает Kinect-подобные средства отслеживания движений, желая поднять на более высокий уровень управление жестами в мобильных устройствах, на что указывает новая патентная заявка, описывающая технологию, приспособленную для будущих смартфонов Android. Под заглавием «Использование камеры для расширенного управления портативным электронным устройством» описано применение лицевой камеры телефона, планшета или другого устройства для захвата и отслеживания движений пальцев в пространстве перед экраном, распознавая «единичное нажатие, двойное, наведение, удержание и вращение».

Google рассматривает Kinect-подобные средства отслеживания движений, желая поднять на более высокий уровень управление жестами в мобильных устройствах, на что указывает новая патентная заявка, описывающая технологию, приспособленную для будущих смартфонов Android. Под заглавием «Использование камеры для расширенного управления портативным электронным устройством» описано применение лицевой камеры телефона, планшета или другого устройства для захвата и отслеживания движений пальцев в пространстве перед экраном, распознавая «единичное нажатие, двойное, наведение, удержание и вращение».

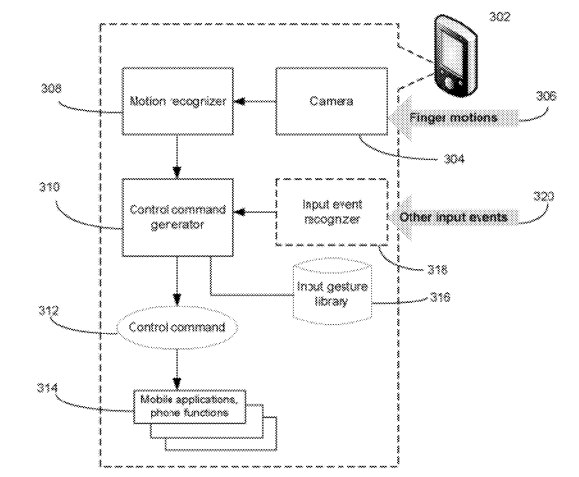

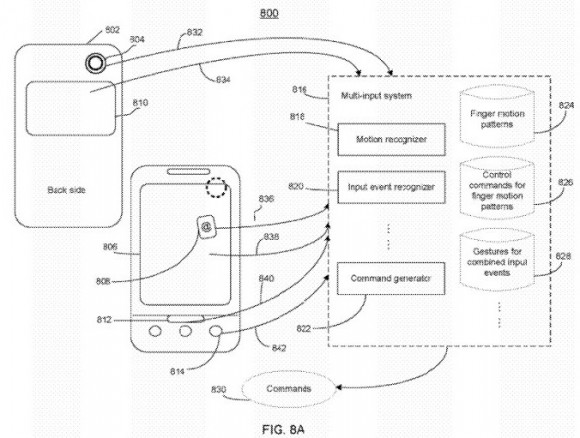

«Системы и методы обеспечивают управление портативным электронным устройством. Оно включает встроенный сенсор изображения. Система определяет движения пальцев пользователя перед сенсором изображения, распознаёт шаблон зафиксированных движений с помощью записанной во времени информации и осуществляет управление портативным электронным устройством на основе распознанного шаблона. Система также получает управляющие команды от других средств ввода, управляя устройством на основе комбинации распознанного шаблона и полученных команд», — сообщается в патентной заявке Google.

В предоставленном описании Google указывает, что управление жестами может быть задействовано для совершения звонков, навигации по мультимедиа и прочего, а также взаимодействовать с другими встроенными сенсорами вроде акселерометра, цифрового компаса, микрофона и так далее.

«Портативным электронным устройством может быть мобильное устройство (включая смартфон вроде Google Nexus), которое способно связываться с другими мобильными аппаратами через сеть. Портативное электронное устройство может быть также музыкальным плеером или другим типом многофункционального портативного потребительского продукта, обладающего встроенной камерой», — конкретизирует Google.

Хотя телефон является наиболее вероятным претендентом на использование этой системы, настойчивые слухи указывают, что она может применяться и в на носимом компьютере дополненной реальности, якобы разрабатываемом в Google X-Labs. Из этих утечек следует, что очки «Google Glasses» на базе Android действительно будут использовать камеру, которая сможет отслеживать движения рук и пальцев перед лицом, распознавая в этих жестах команды для навигации и управления. Интересно, что в отличие от Kinect, в патенте описано применение обычной камеры, а объёмной съёмки с помощью сенсора глубины пространства.

Это не первый случай использования технологии отслеживания движений с помощью камеры мобильных устройств. В 2009 году Sony Ericsson применила подобную систему в смартфонах Yari и Aino для базовых игр и управления музыкальным проигрывателем. А в 2010 году японские исследователи использовали идею считывания жестов в объёмном пространстве для симуляции управления мыши, рисования в объёме и набора текста на виртуальной клавиатуре.

{youtube}8HXnjAyT3cM&feature{/youtube}

К сожалению, пока это лишь патентная заявка, что указывает на некоторую отдалённость реализации технологии в операционной системе Android и других продуктах Google.